오픈 소스 코드 라마 70B 모델 공개

컨텐츠 정보

- 723 조회

본문

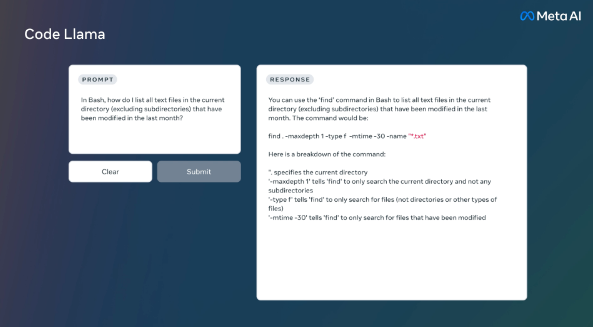

메타가 파라미터 700억 개 크기의 코드 생성 모델 '코드 라마(Code Llama) 70B' 모델을 공개했습니다. 지난 8월에 코드 라마 7B, 13B, 34B 모델을 발표한 이후 약 5개월 만의 소식인데요. 학습에 5000억 개의 토큰을 사용했던 이전 모델과 달리 70B 모델은 토큰 1조 개를 사용했다고 합니다.

기본 코드 라마 70B 모델 이외에도, 파이썬 코드에 특화된 'CodeLlama-70B-Python'과 자연어 지시문(Instruction) 이해에 특화된 'CodeLlama-70B-Instruct' 모델도 함께 공개되었습니다. 크기가 큰 모델인만큼, 70B 모델은 HumanEval, MBPP 벤치마크에서 다른 언어 모델들보다 뛰어난 성능을 보였습니다. 코드 라마는 라마 2처럼 오픈 소스로 제공되며, 연구용이나 상업적 용도로 무료 사용할 수 있고요. 허깅페이스를 통해서도 모델을 사용할 수 있습니다!

관련자료

댓글 0개

등록된 댓글이 없습니다.